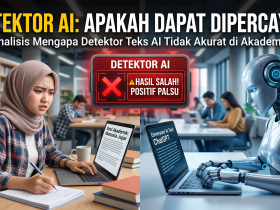

Kehadiran kecerdasan buatan atau Large Language Models (LLM) seperti ChatGPT telah mengubah lanskap penulisan akademik. AI generatif saat ini mampu menghasilkan teks yang sangat koheren dan menyerupai tulisan manusia murni. Sebagai respons terhadap fenomena ini, berbagai detektor AI diciptakan dengan tujuan mendeteksi teks buatan AI bagi mereka yang tidak mendeklarasikan penggunaannya. Namun, sebuah penelitian terbaru menyoroti fakta mengejutkan: sebagian besar temuan dari alat pendeteksi AI ternyata salah. Artikel ini akan membahas mengapa keakuratan detektor AI sangat rendah dan sering menghasilkan tuduhan keliru.

Memahami Keakuratan Detektor AI Melalui Pendekatan Epidemiologi

Studi tersebut mengevaluasi keakuratan detektor AI dengan menggunakan kerangka kerja epidemiologi. Kerangka ini membandingkan detektor teks AI dengan alat tes medis yang digunakan untuk mendeteksi penyakit pada pasien. Dalam dunia medis, terdapat matriks sensitivitas (kemampuan mendeteksi penyakit dengan benar) dan spesifisitas (kemampuan mengidentifikasi pasien sehat dengan benar). Sama halnya dengan alat medis, detektor AI dievaluasi berdasarkan kemampuannya mendeteksi teks buatan AI (sensitivitas) dan kemampuannya untuk tidak salah mengenali tulisan manusia sebagai buatan AI (spesifisitas).

Tingkat Penemuan Palsu (False Discovery Rate) yang Mengkhawatirkan

Masalah terbesar dari detektor AI saat ini adalah tingginya False Discovery Rate (FDR) atau Tingkat Penemuan Palsu. Tingkat FDR yang tinggi ini disebabkan oleh tingkat prevalensi teks AI yang berhadapan dengan detektor yang rendah, serta tingkat sensitivitas alat yang pada dasarnya juga rendah.

Sebagai contoh skenario dalam studi tersebut, meskipun sebuah detektor AI memiliki tingkat spesifisitas yang tinggi, tingkat penemuan palsunya tetap bisa mencapai angka sekitar 78%. Ini berarti ketika sebuah detektor AI mengklaim telah menemukan teks buatan AI, klaim tersebut salah sasaran sebanyak 4 dari 5 kali percobaan. Hal ini berujung pada maraknya kasus positif palsu (false positive), di mana penulis dituduh menggunakan AI padahal mereka menulisnya sendiri secara manual.

Mengapa Alat Pendeteksi AI Mudah Dikelabui?

Rendahnya sensitivitas alat pendeteksi AI sangat dipengaruhi oleh modifikasi yang dapat dilakukan oleh manusia. Teks buatan ChatGPT yang telah diedit ringan oleh manusia atau diproses menggunakan alat parafrase akan membuat tingkat sensitivitas detektor AI menurun drastis. Kondisi ini memicu terjadinya “perlombaan senjata” antara pengembang detektor AI dan pembuat AI generatif yang terus berupaya menghindari deteksi. Akibatnya, mereka yang berniat curang dapat dengan mudah menyembunyikan jejaknya dan lolos dari deteksi, sementara alat pendeteksi AI justru berisiko tinggi menuduh penulis yang jujur.

Dampak Buruk Terhadap Integritas Akademik

Keakuratan detektor AI yang buruk memunculkan kekhawatiran fundamental terhadap etika publikasi dan integritas literatur ilmiah dalam penulisan akademik. Penggunaan detektor AI secara terburu-buru sangat rentan menghasilkan lebih banyak tuduhan palsu dibandingkan identifikasi yang tepat sasaran. Tentu saja hal ini berpotensi merugikan mahasiswa maupun peneliti yang karyanya dituduh sebagai buatan mesin tanpa bukti yang akurat.

Kesimpulan: Transparansi Lebih Baik Daripada Deteksi

Mengingat besarnya celah kelemahan pada detektor teks AI, studi tersebut menyimpulkan bahwa fokus di dunia akademik harus segera dialihkan. Alih-alih bergantung pada detektor AI yang bersifat menghukum dan rentan salah, institusi pendidikan dan penerbit jurnal harus lebih memprioritaskan transparansi serta pengungkapan (disclosure) atas penggunaan AI. Membangun budaya kejujuran dan tanggung jawab dalam penggunaan teknologi dinilai akan jauh lebih efektif daripada terus mengandalkan detektor AI yang pada akhirnya akan menjadi usang.